مطالعه تئوري فراپارامتريسازي را در شبكههاي عصبي كوانتومي ايجاد ميكند توسط آزمايشگاه ملي لوس آلاموس

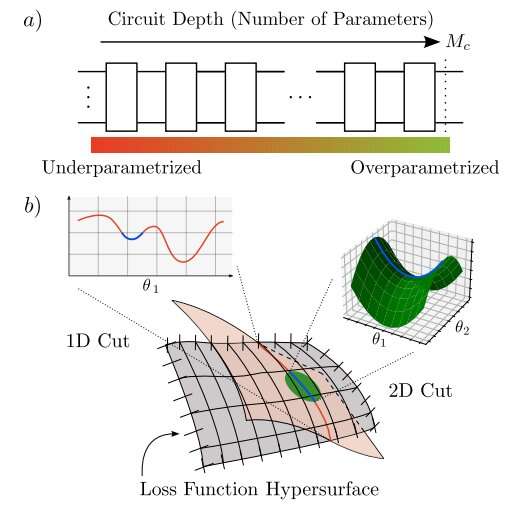

فراپارامتري سازي در شبكه هاي عصبي كوانتومي (QNNs). الف) شرح مدار كوانتومي QNN. با داشتن تعداد كم (زياد) پارامترها، فرد قادر نيست (نميتواند) تمام جهات مربوطه را در فضاي هيلبرت كاوش كند، و بنابراين QNN كمتر پارامتريزه ميشود (بيش از حد پارامتر). ب) سطح خاكستري مربوط به چشم انداز تابع از دست دادن نامحدود است. يك QNN كمتر پارامتريزه شده، يك برش با ابعاد پايين تابع تلفات را بررسي مي كند (برش 1 بعدي روي خطوط قرمز). در اينجا، بهينهساز ميتواند در حداقلهاي محلي جعلي (قسمت آبي) كه تأثير منفي بر بهينهسازي پارامتر دارد، گرفتار شود. با افزايش تعداد پارامترهاي گذشته از آستانه Mc، مي توان يك برش با ابعاد بالاتر از چشم انداز را كاوش كرد (برش دو بعدي بر روي منطقه سبز). همانطور كه نشان داده شده است، برخي از حداقل هاي محلي جعلي قبلي با نقاط زين (قسمت آبي) مطابقت دارند، و بهينه ساز مي تواند از تله كاذب فرار كند. اعتبار: arXiv DOI: 10.48550/arxiv.2109.11676

فراپارامتري سازي در شبكه هاي عصبي كوانتومي (QNNs). الف) شرح مدار كوانتومي QNN. با داشتن تعداد كم (زياد) پارامترها، فرد قادر نيست (نميتواند) تمام جهات مربوطه را در فضاي هيلبرت كاوش كند، و بنابراين QNN كمتر پارامتريزه ميشود (بيش از حد پارامتر). ب) سطح خاكستري مربوط به چشم انداز تابع از دست دادن نامحدود است. يك QNN كمتر پارامتريزه شده، يك برش با ابعاد پايين تابع تلفات را بررسي مي كند (برش 1 بعدي روي خطوط قرمز). در اينجا، بهينهساز ميتواند در حداقلهاي محلي جعلي (قسمت آبي) كه تأثير منفي بر بهينهسازي پارامتر دارد، گرفتار شود. با افزايش تعداد پارامترهاي گذشته از آستانه Mc، مي توان يك برش با ابعاد بالاتر از چشم انداز را كاوش كرد (برش دو بعدي بر روي منطقه سبز). همانطور كه نشان داده شده است، برخي از حداقل هاي محلي جعلي قبلي با نقاط زين (قسمت آبي) مطابقت دارند، و بهينه ساز مي تواند از تله كاذب فرار كند. اعتبار: arXiv DOI: 10.48550/arxiv.2109.11676يك اثبات نظري نشان ميدهد كه تكنيكي به نام فراپارامتريسازي عملكرد در يادگيري ماشين كوانتومي را براي برنامههايي كه كامپيوترهاي كلاسيك را مختل ميكنند، افزايش ميدهد.

ديگو گارسيا مارتين، محقق فوق دكترا، گفت: "ما معتقديم كه نتايج ما در استفاده از يادگيري ماشين براي يادگيري خواص داده هاي كوانتومي، مانند طبقه بندي مراحل مختلف ماده در تحقيقات مواد كوانتومي، كه در كامپيوترهاي كلاسيك بسيار دشوار است، مفيد خواهد بود. " در آزمايشگاه ملي لوس آلاموس او يكي از نويسندگان مقاله جديدي از يك تيم لوس آلاموس در مورد اين تكنيك است كه در Nature Computational Science منتشر شده است .

گارسيا مارتين در سال 2021 به عنوان دانشجوي فارغ التحصيل از دانشگاه خودمختار مادريد روي اين تحقيق در مدرسه تابستاني محاسبات كوانتومي آزمايشگاه كار كرد.

يادگيري ماشيني يا هوش مصنوعي معمولاً شامل آموزش شبكه هاي عصبي براي پردازش اطلاعات - داده ها - و يادگيري نحوه حل يك كار معين است. به طور خلاصه، مي توان شبكه عصبي را به عنوان جعبه اي با دستگيره ها يا پارامترهايي در نظر گرفت كه داده ها را به عنوان ورودي مي گيرد و خروجي اي توليد مي كند كه به پيكربندي دستگيره ها بستگي دارد.

گارسيا مارتين گفت: «در طول مرحله آموزش، الگوريتم با يادگيري اين پارامترها را به روز مي كند و سعي مي كند تنظيمات بهينه آنها را پيدا كند. پس از تعيين پارامترهاي بهينه، شبكه عصبي بايد بتواند آنچه را كه از نمونه هاي آموزشي آموخته است به نقاط داده جديد و ناديده قبلي تعميم دهد.

هم هوش مصنوعي كلاسيك و هم هوش مصنوعي كوانتومي در هنگام آموزش پارامترها يك چالش مشترك دارند، زيرا الگوريتم مي تواند در آموزش خود به پيكربندي كمتر از حد بهينه برسد و متوقف شود.

يك جهش در عملكرد

پارامترسازي بيش از حد، يك مفهوم شناخته شده در يادگيري ماشين كلاسيك است كه پارامترهاي بيشتر و بيشتري را اضافه مي كند، مي تواند از اين توقف جلوگيري كند.

مفاهيم فراپارامتريسازي در مدلهاي يادگيري ماشين كوانتومي تاكنون به خوبي درك نشده بود. در مقاله جديد، تيم Los Alamos يك چارچوب نظري براي پيشبيني تعداد بحراني پارامترهايي ايجاد ميكند كه در آن يك مدل يادگيري ماشين كوانتومي بيش از حد پارامتري ميشود. در يك نقطه بحراني خاص، افزودن پارامترها باعث جهش در عملكرد شبكه مي شود و آموزش مدل به طور قابل توجهي آسان تر مي شود.

مارتين لاروكا، نويسنده اصلي اين مقاله و محقق فوق دكترا در لس آلاموس توضيح داد: «با ايجاد نظريه اي كه زيربناي پارامترسازي بيش از حد در شبكه هاي عصبي كوانتومي است، تحقيقات ما راه را براي بهينه سازي فرآيند آموزش و دستيابي به عملكرد پيشرفته در كاربردهاي عملي كوانتومي هموار مي كند .

با بهره گيري از جنبه هاي مكانيك كوانتومي مانند درهم تنيدگي و برهم نهي، يادگيري ماشين كوانتومي نويد سرعت بسيار بيشتر يا مزيت كوانتومي را نسبت به يادگيري ماشين در رايانه هاي كلاسيك ارائه مي دهد.

اجتناب از تله ها در چشم انداز يادگيري ماشيني

براي نشان دادن يافتههاي تيم لوس آلاموس، ماركو سرزو، دانشمند ارشد روي مقاله و نظريهپرداز كوانتومي در آزمايشگاه، آزمايشي فكري را توصيف كرد كه در آن يك كوهنورد به دنبال بلندترين كوه در يك منظره تاريك، روند آموزش را نشان ميدهد. كوهنورد فقط مي تواند در جهات خاصي قدم بگذارد و پيشرفت آنها را با اندازه گيري ارتفاع با استفاده از يك سيستم GPS محدود ارزيابي مي كند.

سرزو گفت: در اين قياس، تعداد پارامترهاي مدل با جهت هاي موجود براي حركت كوهنورد مطابقت دارد. وي گفت: يك پارامتر امكان حركت به جلو و عقب را فراهم مي كند، دو پارامتر امكان حركت جانبي و غيره را فراهم مي كند. يك چشم انداز داده احتمالاً بر خلاف دنياي كوهنورد فرضي ما بيش از سه بعد خواهد داشت.

با پارامترهاي بسيار كم، واكر نمي تواند به طور كامل كاوش كند و ممكن است يك تپه كوچك را با بلندترين كوه اشتباه بگيرد يا در يك منطقه صاف كه هر قدمي بيهوده به نظر مي رسد گير كند. با اين حال، با افزايش تعداد پارامترها، واكر مي تواند در جهات بيشتري در ابعاد بالاتر حركت كند. آنچه در ابتدا به عنوان يك تپه محلي به نظر مي رسيد ممكن است تبديل به يك دره مرتفع بين قله ها شود. با پارامترهاي اضافي، كوهنورد از به دام افتادن جلوگيري مي كند و قله واقعي يا راه حل مشكل را پيدا مي كند.

برچسب: ،